Letzter Teil - Zukunftsgestaltungen und Fazit

Dinge die wir machen könnten:

- Mehr Charaktere

- 3D Gegenstände

- 3D Hintergünde

- 1:1 Bewegungserkennung

- Maus-WLAN-Arudino

- Mehr Gesten

- Mehr Puppen

- Mehr/weitere Evaluationen

- Overlay Tutorium

(für genauere Beschreibung siehe Blog Ekki: http://irgendwasmitinteraktiv.wordpress.com/2014/07/04/zusammenfassung-der-letzten-wochen-fazit/

Mein Fazit

Mir persönlich hat das Projekt sehr viel Spaß gemacht. Sowohl das Projekt als auch unsere Gruppenarbeit lief super. Natürlich hatte wir auch immer wieder kleine Probleme mit dem System/Sensor aber das kann man nicht vermeiden, sondern man muss versuchen das beste daraus zu machen und daraus zu lernen. Was bei unserem Projekt besonders gut geklappt hat, war der regelmäßige Kontakt mit unserer Zielgruppe. Letztendlich haben wir nicht all das geschafft was wir zu Beginn des Projektes vor hatten aber alles in allem haben wir ein funktionierendes, schönes, gutes Programm, dass Kindern gefallen würde.

Freitag, 4. Juli 2014

Teil 13

Löten und vernähen

Nachdem wir den Drucksensor in das Projekt integriert haben und unser Programm soweit fertig war haben wir uns an die Maus begeben.

Wir haben hierfür den Bewegunssensor in eine Styropor-Kugel platziert und diese mittels Klettverschluss im Kopf der Maus befestigt. Zudem haben wir mit Watte die Kugel geschützt.

Außerdem haben wir (wieder) mit Klettverschluss den Drucksensor an die rechte Hand der Maus geklettet. So kann man bequem den Drucksensor abmachen (oder dran).

Zu guter Letzt haben wir die Maus wieder zugenäht.

Nachdem wir den Drucksensor in das Projekt integriert haben und unser Programm soweit fertig war haben wir uns an die Maus begeben.

Wir haben hierfür den Bewegunssensor in eine Styropor-Kugel platziert und diese mittels Klettverschluss im Kopf der Maus befestigt. Zudem haben wir mit Watte die Kugel geschützt.

Außerdem haben wir (wieder) mit Klettverschluss den Drucksensor an die rechte Hand der Maus geklettet. So kann man bequem den Drucksensor abmachen (oder dran).

Zu guter Letzt haben wir die Maus wieder zugenäht.

Samstag, 28. Juni 2014

Teil 12

Einfärben + Bilder zu den Animationen

Wir haben letzte Woche hauptsächlich an/mit dem Arduino gearbeitet und versucht die Bewegungserkennung zu verbessern, welches uns jedoch nicht gelang.

Währenddessen habe ich unsere Maus eingefärbt und somit unserer Handpuppe, welche blau ist, angepasst.

Hier ein paar Bilder der Maus (in max und in verschieden Animations-Posen):

Wir müssen nun noch die Maus mit der Technik ausstatten (Sensoren etc.) diese (Technik) muss vorher noch verlötet werden und wir müssen mit dem Drucksensor eine Interaktion integrieren.

Wir haben letzte Woche hauptsächlich an/mit dem Arduino gearbeitet und versucht die Bewegungserkennung zu verbessern, welches uns jedoch nicht gelang.

Währenddessen habe ich unsere Maus eingefärbt und somit unserer Handpuppe, welche blau ist, angepasst.

Hier ein paar Bilder der Maus (in max und in verschieden Animations-Posen):

Wir müssen nun noch die Maus mit der Technik ausstatten (Sensoren etc.) diese (Technik) muss vorher noch verlötet werden und wir müssen mit dem Drucksensor eine Interaktion integrieren.

Sonntag, 15. Juni 2014

Teil 11

Evaluation Teil II

Die vergangene Woche habe unser aktuelles Programm (wieder) mit unserer Zielgruppe evaluiert.

Diesmal mit nur 5 Kindern im Alter von 7-13. Auch hier kristallisierten sich wieder ein paar Grundlegende Probleme heraus.

Beispielsweise fanden ein paar Kinder den Play-Button nach der Aufnahme zu klein, sie vermissten einen Pause-Button und die Zahl bei der Aufnahme ist verwirrend genau (die meisten sagten "zu groß", es sind aber 5 oder 6 Nachkommastellen, es ist also sehr genau).

Eines der größeren Probleme war, dass die Bewegungen des Sensores (noch) nicht mit den erwarteten Bewegungen am Bildschirm übereinstimmen. Also die Maus soll eine Bewegung nach links/rechts machen, also bewegten die Kinder die Puppe (es wurde eine einfache Socke verwendet) nach links/rechts. Dies müssen und werden wir ändern (die passende Bewegung ist/war eine Neigung gewesen)

Die vergangene Woche habe unser aktuelles Programm (wieder) mit unserer Zielgruppe evaluiert.

Diesmal mit nur 5 Kindern im Alter von 7-13. Auch hier kristallisierten sich wieder ein paar Grundlegende Probleme heraus.

Beispielsweise fanden ein paar Kinder den Play-Button nach der Aufnahme zu klein, sie vermissten einen Pause-Button und die Zahl bei der Aufnahme ist verwirrend genau (die meisten sagten "zu groß", es sind aber 5 oder 6 Nachkommastellen, es ist also sehr genau).

Eines der größeren Probleme war, dass die Bewegungen des Sensores (noch) nicht mit den erwarteten Bewegungen am Bildschirm übereinstimmen. Also die Maus soll eine Bewegung nach links/rechts machen, also bewegten die Kinder die Puppe (es wurde eine einfache Socke verwendet) nach links/rechts. Dies müssen und werden wir ändern (die passende Bewegung ist/war eine Neigung gewesen)

Teil 10

Anfang Juni, Zwischenpräsentation

In dieser Zeit haben wir uns alle Hauptsächlich damit beschäftigt alles für die letzte Zwischenpräsentation fertig zu bekommen. So haben wird die Animationen (nicht alle) eingefügt, die mit dem Bewegunssensor abgerufen werden. So habe ich Jonas dabei geholfen die Animationen in das Unity Programm einzubringen

Nun kann mal also mithilfe der (bis dahin) fertige GUI eine Szene erstellen, mit der Maus interagieren, Aufnahmen machen, speichern und laden.

In dieser Zeit haben wir uns alle Hauptsächlich damit beschäftigt alles für die letzte Zwischenpräsentation fertig zu bekommen. So haben wird die Animationen (nicht alle) eingefügt, die mit dem Bewegunssensor abgerufen werden. So habe ich Jonas dabei geholfen die Animationen in das Unity Programm einzubringen

Nun kann mal also mithilfe der (bis dahin) fertige GUI eine Szene erstellen, mit der Maus interagieren, Aufnahmen machen, speichern und laden.

Teil 9

Arbeit Ende Mai, Animationen

Die vergangen Wochen habe ich den Blog etwas vernachlässigt, ich werde nun hier alles "nachreichen".

Zunächst habe ich die Maus (unser Hauptcharakter) geriggt (Knochen hinzugefügt) und Animationen erstellt.

Zu den Animationen gehören:

- eine Stehanimation (leichte Bewegung des Körpers und des Schwanzes)

- eine Laufanimation (rinkes Bein, rechtes Bein, Körperbewegung)

- eine Sprunganimation (der Charakter springt mit allen vieren von sich gestreckt)

- eine "Specialanimation" (hier machte der Charakter eine Art Handstand nach rechts)

Die vergangen Wochen habe ich den Blog etwas vernachlässigt, ich werde nun hier alles "nachreichen".

Zunächst habe ich die Maus (unser Hauptcharakter) geriggt (Knochen hinzugefügt) und Animationen erstellt.

Zu den Animationen gehören:

- eine Stehanimation (leichte Bewegung des Körpers und des Schwanzes)

- eine Laufanimation (rinkes Bein, rechtes Bein, Körperbewegung)

- eine Sprunganimation (der Charakter springt mit allen vieren von sich gestreckt)

- eine "Specialanimation" (hier machte der Charakter eine Art Handstand nach rechts)

Freitag, 23. Mai 2014

Teil 8

Charaktere, Gegenstände und Hintergründe

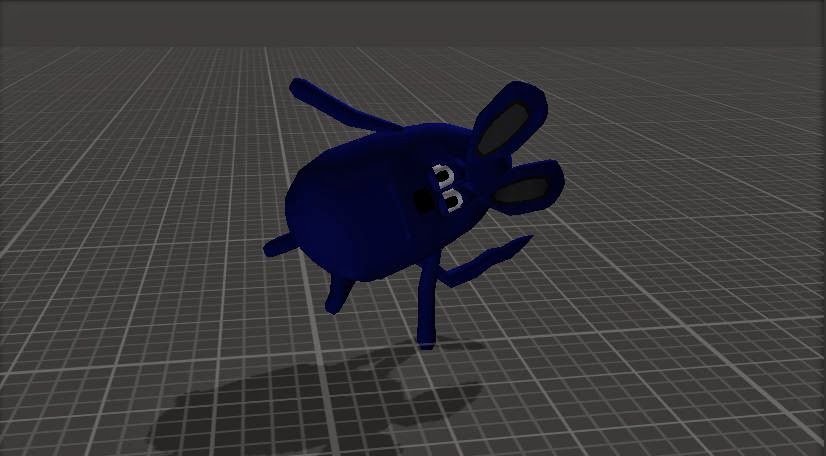

Die vergangenen eineinhalb Woche habe ich mich hauptsächlich mit dem Design beschäftigt. Hierfür habe ich mit 3DS max einen Fisch und eine Maus (s. Bild 1.1) (Charaktere), einen Ball (s. Bild 1.2) und ein Spielzeugauto (Gegenstände) erstellt. Zudem habe ich alle Hintergründe (s. Bild 1.3) gemalt. Wir haben uns nun entschieden uns erstmal auf einen Charakter zu konzentrieren und vorerst nur diesen in das Programm einbinden.

Für die nächste Woche haben wir uns vorgenommen den Charakter in Unity mittels Sensor bewegen zu können und kleine

Aufnahmen anzufertigen. Hierfür muss ich mit "rigging" beschäftigen, Bewegungen abspeicher, dies in Unity importieren und als Animation abrufen.

Projektstatus: GUI ist fertig, (zweiter) Bewegungssensor funktioniert, Unity übernimmt Bewegungen des Sensores und lässt (noch) 2D Bild auf X-Achse bewegen.

|

| 1.1 Maus |

Die vergangenen eineinhalb Woche habe ich mich hauptsächlich mit dem Design beschäftigt. Hierfür habe ich mit 3DS max einen Fisch und eine Maus (s. Bild 1.1) (Charaktere), einen Ball (s. Bild 1.2) und ein Spielzeugauto (Gegenstände) erstellt. Zudem habe ich alle Hintergründe (s. Bild 1.3) gemalt. Wir haben uns nun entschieden uns erstmal auf einen Charakter zu konzentrieren und vorerst nur diesen in das Programm einbinden.

|

| 1.2 Ball |

Aufnahmen anzufertigen. Hierfür muss ich mit "rigging" beschäftigen, Bewegungen abspeicher, dies in Unity importieren und als Animation abrufen.

Projektstatus: GUI ist fertig, (zweiter) Bewegungssensor funktioniert, Unity übernimmt Bewegungen des Sensores und lässt (noch) 2D Bild auf X-Achse bewegen.

|

| 1.3 Hintergund: Fußballwiese |

Montag, 12. Mai 2014

Lecture 7

Design und Präsentation

Die vergangene Woche habe ich (zusammen mit Sebastian) viel am Design bzw. den Charakteren, Gegenständen und Hintergründen gearbeitet. Hierfür haben wir uns erst passende Dinge überlegt und diese dann aufgeteilt. So waren meine Aufgaben für Charaktere ein Fisch und eine Maus, für Gegenstände ein Ball einen Eimer mit Schaufel und ein Flugzeug und für die Hintergründe ein Kinderzimmer, das All, eine Unterwasserwelt und einen Fußballplatz. Bis zu dieser Woche konnte ich bereits fast die Hälfte der Aufgaben erledigen bzw erstellen.

Zudem haben wir eine Zwischenpräsentation erstellt.

Allgemein ist unser Projekt ein wenig verzögert, da ein Bewegungssensor erst gekauft werden musste (der erste viel aus), welcher nun in "Betrieb" genommen wurde und funktioniert. Außerdem wurde mit der "Programmierung" in Unity begonnen und das Farbkonzept angewandt.

Die kommende Woche wollen wir die "Animation" starten und alle Charaktere, Gegenstände und Hintergründe fertig haben.

Die vergangene Woche habe ich (zusammen mit Sebastian) viel am Design bzw. den Charakteren, Gegenständen und Hintergründen gearbeitet. Hierfür haben wir uns erst passende Dinge überlegt und diese dann aufgeteilt. So waren meine Aufgaben für Charaktere ein Fisch und eine Maus, für Gegenstände ein Ball einen Eimer mit Schaufel und ein Flugzeug und für die Hintergründe ein Kinderzimmer, das All, eine Unterwasserwelt und einen Fußballplatz. Bis zu dieser Woche konnte ich bereits fast die Hälfte der Aufgaben erledigen bzw erstellen.

Zudem haben wir eine Zwischenpräsentation erstellt.

Allgemein ist unser Projekt ein wenig verzögert, da ein Bewegungssensor erst gekauft werden musste (der erste viel aus), welcher nun in "Betrieb" genommen wurde und funktioniert. Außerdem wurde mit der "Programmierung" in Unity begonnen und das Farbkonzept angewandt.

Die kommende Woche wollen wir die "Animation" starten und alle Charaktere, Gegenstände und Hintergründe fertig haben.

Montag, 5. Mai 2014

Lecture 6

Projektupdate

Zunächst einmal haben wir uns zusammen die Lösungen der Probleme, welche bei der Evaluation aufgetreten sind. Für das das "Exportieren-Problem" verwenden wir nun an die Phrase "Als Film speichern", so versteht unsere Zielgruppe besser was gemeint ist. Das "Play-Button-Menü-Problem" lösen wir, indem wir nur eine Playbutton verwenden/anzeigen werden, sodass keine Frage aufkommen sollten. Um ganz sicher zu sein, werden wir bei jeder erstmaligen Benutzung eine "Overlay-Tutorial" einführen, in dem kurz und knapp die einzelnen Buttons (die GUI) erklärt wird.

Diese Woche habe ich mich bezüglich Bewegungsspeicherung informiert. Hierbei bin ich auf eine Seite gestoßen, die uns in unserem Projekt behilflich sein kann. (http://answers.unity3d.com/questions/357525/extract-calculate-position-data.html)

Grundlegend zusammengefasst kann man sagen, dass hier eine Array für die Koordinaten erstellt wird, welche dann (wiederum) bei einer Bearbeitung der Szene aufgerufen werden müssen, daher muss die Abfrage mehrmals pro Sekunde geschehen.

Meine Gruppenmitglieder haben unter anderem das (grobe) Interface fertiggestellt, das Farbkonzept verfeinert und mit dem Arduino gearbeitet, sodass wir bis nächste Woche (hoffentlich) erste Tests (mit dem System) machen könne.

Zunächst einmal haben wir uns zusammen die Lösungen der Probleme, welche bei der Evaluation aufgetreten sind. Für das das "Exportieren-Problem" verwenden wir nun an die Phrase "Als Film speichern", so versteht unsere Zielgruppe besser was gemeint ist. Das "Play-Button-Menü-Problem" lösen wir, indem wir nur eine Playbutton verwenden/anzeigen werden, sodass keine Frage aufkommen sollten. Um ganz sicher zu sein, werden wir bei jeder erstmaligen Benutzung eine "Overlay-Tutorial" einführen, in dem kurz und knapp die einzelnen Buttons (die GUI) erklärt wird.

Diese Woche habe ich mich bezüglich Bewegungsspeicherung informiert. Hierbei bin ich auf eine Seite gestoßen, die uns in unserem Projekt behilflich sein kann. (http://answers.unity3d.com/questions/357525/extract-calculate-position-data.html)

Grundlegend zusammengefasst kann man sagen, dass hier eine Array für die Koordinaten erstellt wird, welche dann (wiederum) bei einer Bearbeitung der Szene aufgerufen werden müssen, daher muss die Abfrage mehrmals pro Sekunde geschehen.

Meine Gruppenmitglieder haben unter anderem das (grobe) Interface fertiggestellt, das Farbkonzept verfeinert und mit dem Arduino gearbeitet, sodass wir bis nächste Woche (hoffentlich) erste Tests (mit dem System) machen könne.

Sonntag, 27. April 2014

Lecture 5

Evaluation und Evaluationsbericht

Vergangene zwei Wochen beschäftigte ich mit der Evaluation unseres Programms an potentiellen Benutzern bzw. unserer Zielgruppe.

Insgesamt evaluierten zwölf Probanten/innen im alter von sechs bis sechszehn Jahren unser Programm. Hierbei sind zwei maßgebliche Probleme aufgefallen.

Erstens: Nach der Aufnahme sehen die Benutzer eine reihe "Abspielbuttons" (also Play, Rewind etc), hier benutzten die Probanten die Knöpfe anders als wir erwarteten bzw. vorgesehen hatten. Die meisten gingen davon aus, dass man mit einem Klick auf den Play Button seinen ganzen bis dato aufgenommen Film sehen kann (eig. sollte der Benutzer erst auf "|<" klicken bevor er sich alles anschauen kann, da der "Zeiger" im Moment nach der Aufnahme immer am Ende steht).

Eine Lösung wäre einerseits, das "Buttonverständnis*" der Benutzer anzugleichen, anderseits könnte man mit einem kleinem "Overlay-Tutorium" oder Video bei der ersten Benutzung anwenden. In dem der Benutzer kurz erklärt bekommt wie er die Buttons zu verstehen hat und sie benutzt. Man könnte auch alle Buttons bis auf Play weglassen um so Verwirrung von vorn herein aus dem weg zu gehen. *Hier und beim "anpassen des Buttonverständnises) müsste man allerdings dem Benutzer einen hinweis geben (wenn er weiter aufnehmen möchte und sich sein Zeiger nicht am Ende befindet), wo sich sein Zeiger momentan befindet und ob er sich sicher ist, seine vorherige Aufnahme zu überschreiben oder lieber am Ende des bis jetzt aufgenommen fortfahren möchte.

Zweitens: Das Wort Exportieren ist in unserer besagten Altersgruppe kaum bis gar nicht bekannt. Als Lösung hierfür könnte man das Wort in seiner Bedeutung (und im hier dazugehörigen Konzext) umschreiben, wie z.B. "als Film speichern" oder ähnliches.

Nächster Schritt ist nun, dass wir uns festlegen, wie wir diese Änderungen vornehmen und "start" der Programmierarbeit.

Die gesamte Dokumentation hier ansehen:

https://drive.google.com/file/d/0B5FISQTQAU22WDZzdWtIMzRSY2s/edit?usp=sharing

Vergangene zwei Wochen beschäftigte ich mit der Evaluation unseres Programms an potentiellen Benutzern bzw. unserer Zielgruppe.

Insgesamt evaluierten zwölf Probanten/innen im alter von sechs bis sechszehn Jahren unser Programm. Hierbei sind zwei maßgebliche Probleme aufgefallen.

Erstens: Nach der Aufnahme sehen die Benutzer eine reihe "Abspielbuttons" (also Play, Rewind etc), hier benutzten die Probanten die Knöpfe anders als wir erwarteten bzw. vorgesehen hatten. Die meisten gingen davon aus, dass man mit einem Klick auf den Play Button seinen ganzen bis dato aufgenommen Film sehen kann (eig. sollte der Benutzer erst auf "|<" klicken bevor er sich alles anschauen kann, da der "Zeiger" im Moment nach der Aufnahme immer am Ende steht).

Eine Lösung wäre einerseits, das "Buttonverständnis*" der Benutzer anzugleichen, anderseits könnte man mit einem kleinem "Overlay-Tutorium" oder Video bei der ersten Benutzung anwenden. In dem der Benutzer kurz erklärt bekommt wie er die Buttons zu verstehen hat und sie benutzt. Man könnte auch alle Buttons bis auf Play weglassen um so Verwirrung von vorn herein aus dem weg zu gehen. *Hier und beim "anpassen des Buttonverständnises) müsste man allerdings dem Benutzer einen hinweis geben (wenn er weiter aufnehmen möchte und sich sein Zeiger nicht am Ende befindet), wo sich sein Zeiger momentan befindet und ob er sich sicher ist, seine vorherige Aufnahme zu überschreiben oder lieber am Ende des bis jetzt aufgenommen fortfahren möchte.

Zweitens: Das Wort Exportieren ist in unserer besagten Altersgruppe kaum bis gar nicht bekannt. Als Lösung hierfür könnte man das Wort in seiner Bedeutung (und im hier dazugehörigen Konzext) umschreiben, wie z.B. "als Film speichern" oder ähnliches.

Nächster Schritt ist nun, dass wir uns festlegen, wie wir diese Änderungen vornehmen und "start" der Programmierarbeit.

Die gesamte Dokumentation hier ansehen:

https://drive.google.com/file/d/0B5FISQTQAU22WDZzdWtIMzRSY2s/edit?usp=sharing

Sonntag, 13. April 2014

Lecture 4

Update

Diese Wochen haben wir unser Paper-Prototype in Axure "verwirklicht". Allgemein kann man sagen, dass das Konzept für uns Projekt steht. Kommende Woche werden wir den Prototypen mit "potentiellen Kunden" evaluieren und die Testergebnisse auswerten.

User Case: (siehe Ekki's Blog)

http://irgendwasmitinteraktiv.wordpress.com/2014/04/08/projektidee-und-szenario/

Diese Wochen haben wir unser Paper-Prototype in Axure "verwirklicht". Allgemein kann man sagen, dass das Konzept für uns Projekt steht. Kommende Woche werden wir den Prototypen mit "potentiellen Kunden" evaluieren und die Testergebnisse auswerten.

User Case: (siehe Ekki's Blog)

http://irgendwasmitinteraktiv.wordpress.com/2014/04/08/projektidee-und-szenario/

Mittwoch, 2. April 2014

Lecture 3

Planung und Paper Prototype

Nachdem wir angefangen haben einen Paper Prototype für unser noch namenloses Projekt zu erstellen wurden mir klar, dass wir noch nicht mal die Hälfte für unser Projekt geplant hatten. Bei/nach dem Evaluieren sind "uns" auch noch ein paar Fragen aufgekommen, welche wir aber im nachhinein alle beantworten haben.

Zunächst Grundlegende Informationen:

Der Benutzer (Zielgruppe 8-12) startet das Programm und befindet sich auf einer Startseite auf dieser er zwischen Szenen erstellen, Szene laden und Beenden auswählen kann. Das Programm läuft auf einem normalen PC mit Maus (kein Touch!). Zudem gehen wir davon aus, dass ein 8 Jähriger heutzutage mit einer Computermaus umgehen kann.

Szene erstelle: Dem Benutzer wird von vornherein jeweils ein Feature vorgegeben, welches er ändern kann. Er kann nun aber selber entscheiden welchen Charakter, Hintergrund und Gegenstand er in seiner Szenen haben möchte (evtl mehr Features). Von allem gibt es eine Vorauswahl die beliebig verknüpft werden kann (z. B. ein Bär in der Unterwasserwelt). Es gibt Universelle "Handlungen", wie Bewegung unten, oben, links, rechts, Mund auf und zu, welche für alle Charaktere verwendet werden können. Außerdem kann er durch eine Button eine Zufällige Auswahl treffen. Sobald der Benutzer weiter klickt, sieht er seine Auswahl und kann durch einen Ändern Button seine Voreinstellungen ändern oder mit der Aufnahme beginnen.

Hierfür zieht er die Puppe an, welche durch einen Bewegungs- oder Beschleunigungssensor und einem Drucksensor an einem Arduino angeschlossen ist, an. Wir haben uns zudem überlet die Puppe mit einem Ein-/Ausschaltschlater auszustatten, damit der Benutzer keine Probleme mit der Bedienung der Maus und der Puppe (während der Aufnahme) bekommt.

Bereits jetzt kann der Benutzer die Bewegungen testen ohne das aufgenommen wird.

Durch drücken der Leertaste oder des Aufnahme starten Button beginnt die Aufnahme. Nun werden die Bewegungen der Puppe abgefangen (bzw. die Werte) und umgesetzt. [Stopp/Leeraste = Aufnahme Pause + Puppe ablegen]

Der Benutzer kann nun sich seine Aufnahme wieder ansehen, seine Voreinstellungen ändern, Speichern (und Exportieren), Verlassen oder Aufnahme fortsetzten.

Szene laden: Der Benutzer kann an einer gespeicherten Szene weiterarbeiten.

Wir haben uns bereits über die Sensoren informiert bzw. mit ihnen gearbeitet und wollen sofort anfangen unsere Idee umzusetzen.

Die nächsten Schritte werden sein:

Festlegung der zu verwenden Sensoren, erste Arbeiten mit Arduino.

Nachdem wir angefangen haben einen Paper Prototype für unser noch namenloses Projekt zu erstellen wurden mir klar, dass wir noch nicht mal die Hälfte für unser Projekt geplant hatten. Bei/nach dem Evaluieren sind "uns" auch noch ein paar Fragen aufgekommen, welche wir aber im nachhinein alle beantworten haben.

Zunächst Grundlegende Informationen:

Der Benutzer (Zielgruppe 8-12) startet das Programm und befindet sich auf einer Startseite auf dieser er zwischen Szenen erstellen, Szene laden und Beenden auswählen kann. Das Programm läuft auf einem normalen PC mit Maus (kein Touch!). Zudem gehen wir davon aus, dass ein 8 Jähriger heutzutage mit einer Computermaus umgehen kann.

Szene erstelle: Dem Benutzer wird von vornherein jeweils ein Feature vorgegeben, welches er ändern kann. Er kann nun aber selber entscheiden welchen Charakter, Hintergrund und Gegenstand er in seiner Szenen haben möchte (evtl mehr Features). Von allem gibt es eine Vorauswahl die beliebig verknüpft werden kann (z. B. ein Bär in der Unterwasserwelt). Es gibt Universelle "Handlungen", wie Bewegung unten, oben, links, rechts, Mund auf und zu, welche für alle Charaktere verwendet werden können. Außerdem kann er durch eine Button eine Zufällige Auswahl treffen. Sobald der Benutzer weiter klickt, sieht er seine Auswahl und kann durch einen Ändern Button seine Voreinstellungen ändern oder mit der Aufnahme beginnen.

Hierfür zieht er die Puppe an, welche durch einen Bewegungs- oder Beschleunigungssensor und einem Drucksensor an einem Arduino angeschlossen ist, an. Wir haben uns zudem überlet die Puppe mit einem Ein-/Ausschaltschlater auszustatten, damit der Benutzer keine Probleme mit der Bedienung der Maus und der Puppe (während der Aufnahme) bekommt.

Bereits jetzt kann der Benutzer die Bewegungen testen ohne das aufgenommen wird.

Durch drücken der Leertaste oder des Aufnahme starten Button beginnt die Aufnahme. Nun werden die Bewegungen der Puppe abgefangen (bzw. die Werte) und umgesetzt. [Stopp/Leeraste = Aufnahme Pause + Puppe ablegen]

Der Benutzer kann nun sich seine Aufnahme wieder ansehen, seine Voreinstellungen ändern, Speichern (und Exportieren), Verlassen oder Aufnahme fortsetzten.

Szene laden: Der Benutzer kann an einer gespeicherten Szene weiterarbeiten.

Wir haben uns bereits über die Sensoren informiert bzw. mit ihnen gearbeitet und wollen sofort anfangen unsere Idee umzusetzen.

Die nächsten Schritte werden sein:

Festlegung der zu verwenden Sensoren, erste Arbeiten mit Arduino.

Mittwoch, 26. März 2014

Lecture 2

Festlegung des Projekts

Daher haben wir uns entschlossen unsere zweite Idee auszuarbeiten.

Hier die Idee genauer beschrieben:

Nachdem wir uns genauer mit unserem Favoriten Thema (Multiplayer mit Charaktereigenschaften auf dem Surface) befasst haben, haben wir festgestellt, dass das gar nicht mal so einfach bzw. ziemlich komplex ist.

Daher haben wir uns entschlossen unsere zweite Idee auszuarbeiten.

Hier die Idee genauer beschrieben:

Interaktives Kinder-Puppentheater

Durch einen Sensor in eine Handpuppe werden Werte abgriffe, welche über das Arduino an den PC weitergeleitet werden. Bestimmte Wertebereichen werden bestimmten Aktionen zugewiesen. So kann z.B eine Bewegung der Pupe von links nach rechts erkannt werden.

All diese Aktionen werden nun digital angezeigt, allerdings als "leeres Objekt", denn nun kann sich das Kind sein eigenes Theater/Filmchen erstellen. Es kann sich nun z. B. eines der Vorgegebenen Charaktere aussuchen (und anklicken). Nun ist das "leere Objekt" beispielsweise ein Krokodil. Als nächsten Schritt kann das Kind sich ein Hintergrund aussuchen usw. Es können auch mehrere Charaktere mitspielen, sodass am Ende ein echtes Kinder-Theater aka Film herauskommt.

Zum Schluss kann das Kinder-Thaeater auf eine DVD (oder USB...) gebrannt werden, welches auch als Belohnung dient.

Zum Schluss kann das Kinder-Thaeater auf eine DVD (oder USB...) gebrannt werden, welches auch als Belohnung dient.

(Natürlich können es auch ältere Menschen verwenden)

Dienstag, 18. März 2014

Lecture 1

Meine Ideen (Gruppen-Brainstormin)

1. Interaktives-Gruppen-Spiel auf dem Surface mit Charaktereigenschaften

Es handelt sich hier hierbei um ein Gruppenspiel, welches man nur "genwinnt" wenn man im Team zusammenarbeitet.

Jedem Charakter sollen Eigenschaften zugewiesen werden können. Durch diese Eigenschaften, welche sich den der eigenen ähneln sollen, wird das Team in verschiedenen Aufgaben im Spiel vor Aufgaben stellen, die auch zu Konflikten führen können, eingeleitet durch die Charaktereigenschaften.

Das zuweisen/erstellen der Charakter und ihrer Eigenschaften soll so geschehne, dass kein Teammitglied mitbekommt wie sich der Spieler entscheidet.

Zudem sollen die Spieler den Verlauf der Geschichte durch ihr Handeln selbst bestimmen (siehe "!000 Geschichten..." Bücher).

Das gesamte Spiel soll an einem (großen) Surface spielbar sein, da hier alle (max.) 4 Spieler platz finden. Die Kommunikation und Teamarbeit wird hier nach vorne gestellt.

2. Handpuppenspiel

Durch Sensoren (oder Motion Detection) sollen die Bewegungen eines Handpuppenspiels (bsp Kassperlestheater) aufgenommen werden und auf einem Bilderschirm virtuell gesehen werden können.

Mglk 1:

Die Kinder können nun aus ein Vorauswahl verschiedener Hintergründe sich ihr eigenes Puppenspiel zusammenstellen.

Mglk 2.

Die Kinder können nun "halbvirtuelle" Spiele spielen. Bsp. auf dem Bildschirm werden Rechenaufgaben angezeigt und es fliegen Zahler umher, auch die richtige Anwort. Die Kinder müssen nun mit den richtigen Hanpuppen die richtige Zahl "antippen)

Zusätzliche Idee:

Oculus Rift Drunken Simulator (basierend auf die Polizeiaufklärung in der Schule ~9. Klasse)

1. Interaktives-Gruppen-Spiel auf dem Surface mit Charaktereigenschaften

Es handelt sich hier hierbei um ein Gruppenspiel, welches man nur "genwinnt" wenn man im Team zusammenarbeitet.

Jedem Charakter sollen Eigenschaften zugewiesen werden können. Durch diese Eigenschaften, welche sich den der eigenen ähneln sollen, wird das Team in verschiedenen Aufgaben im Spiel vor Aufgaben stellen, die auch zu Konflikten führen können, eingeleitet durch die Charaktereigenschaften.

Das zuweisen/erstellen der Charakter und ihrer Eigenschaften soll so geschehne, dass kein Teammitglied mitbekommt wie sich der Spieler entscheidet.

Zudem sollen die Spieler den Verlauf der Geschichte durch ihr Handeln selbst bestimmen (siehe "!000 Geschichten..." Bücher).

Das gesamte Spiel soll an einem (großen) Surface spielbar sein, da hier alle (max.) 4 Spieler platz finden. Die Kommunikation und Teamarbeit wird hier nach vorne gestellt.

2. Handpuppenspiel

Durch Sensoren (oder Motion Detection) sollen die Bewegungen eines Handpuppenspiels (bsp Kassperlestheater) aufgenommen werden und auf einem Bilderschirm virtuell gesehen werden können.

Mglk 1:

Die Kinder können nun aus ein Vorauswahl verschiedener Hintergründe sich ihr eigenes Puppenspiel zusammenstellen.

Mglk 2.

Die Kinder können nun "halbvirtuelle" Spiele spielen. Bsp. auf dem Bildschirm werden Rechenaufgaben angezeigt und es fliegen Zahler umher, auch die richtige Anwort. Die Kinder müssen nun mit den richtigen Hanpuppen die richtige Zahl "antippen)

Zusätzliche Idee:

Oculus Rift Drunken Simulator (basierend auf die Polizeiaufklärung in der Schule ~9. Klasse)

Abonnieren

Posts (Atom)